La Super-Inteligencia 🧠 AGI

Llegará en menos de 3 años. Lo cambiará TODO. Prepárate para el gran cambio de nuestra era!

Los laboratorios de IA confían plenamente en que pronto llegarán modelos de IA más grandes y potentes, que permitirán crear agentes y sistemas autónomos más inteligentes que los doctorados humanos.

Y no van a parar ahí.

La Super-Inteligencia (o Inteligencia Artificial General, AGI) es el objetivo a medio plazo.

Los CEO de dos de los principales laboratorios de IA, Sam Altman, de OpenAI, y Dario Amodei, de Anthropic, han hablado recientemente de la próxima era de las máquinas superinteligentes.

Hay una cosa clara.

Una vez alcancemos la Super-Inteligencia (o AGI) el mundo no volverá a ser igual. Será probablemente el cambio más importante como especie que hemos tenido.

Igual que el descubrimiento de la escritura dio el paso de la prehistoria a las edades modernas (pasando por la edad antigua y edad media…) Habrá un punto de inflexión desde la actual era de la PRE-SUPERINTELIGENCIA a lo que vendrá después.

Si todavía no estás suscrito, apúntate a esta newsletter de IA totalmente gratis hoy, antes de que se haga de pago. 😎 ✊🏾

Hoy vamos a ver principalmente dos cosas:

Como la Super-inteligencia puede llegar más rápido de lo que creemos

Y como las IA van a seguir cambiando nuestra sociedad incluso antes de que tengamos una Superinteligencia.

Pero antes el sponsor de esta edición de la newsletter

Transforma tu negocio con ToolChatBot: Esta herramienta IA Automatiza la atención al cliente, responde al instante y optimiza tus operaciones sin complicaciones.

Mejora la experiencia de tus clientes con un chatbot inteligente que trabaja por ti.

La SuperInteligencia llegará en un máximo de 3 años.

Este es Dario Amodei.

Es el CEO de Claude, una de las IA más avanzadas del mundo y principal competencia de OpenAI (ChatGPT)

Hace unos días, en una conversación de 5 horas y media con @lexfridman, reveló nuestra línea de tiempo hacia la superinteligencia.

Déjame ahorrarte 5 horas!

👇

El timeline que lo cambia todo:

Tendremos IA superinteligente para 2026-2027.

Pero esa es su estimación conservadora; los datos internos sugieren que incluso antes.

Y acaban de revelar las 5 señales de que estamos más cerca de lo que se pensaba:

En primer lugar, echemos un vistazo a la situación actual.

Existen 2 enfoques para construir AGI:

OpenAI: Quiere competir por ser el primero

Anthropic: Está en la carrera por la seguridad

Pero el CEO de Anthropic acaba de revelar por qué esta carrera tiene un giro:

El ganador podría determinar el destino de la humanidad.

Qué le quita el sueño:

El mal uso catastrófico (armas cibernéticas/biológicas)

Autonomía de la IA (sistemas demasiado poderosos para controlarlos)

«Un gran poder conlleva una gran responsabilidad».

Pero aquí está la parte aterradora:

Las personas inteligentes y educadas rara vez causan daños catastróficos.

Esta «salvaguarda natural» protegió a la humanidad durante siglos.

Pero la IA rompe este equilibrio - dando capacidades impensables y peligrosas a cualquiera. Incluso a aquellos con las peores intenciones.

Las pruebas demuestran que esta protección ya se está desmoronando.

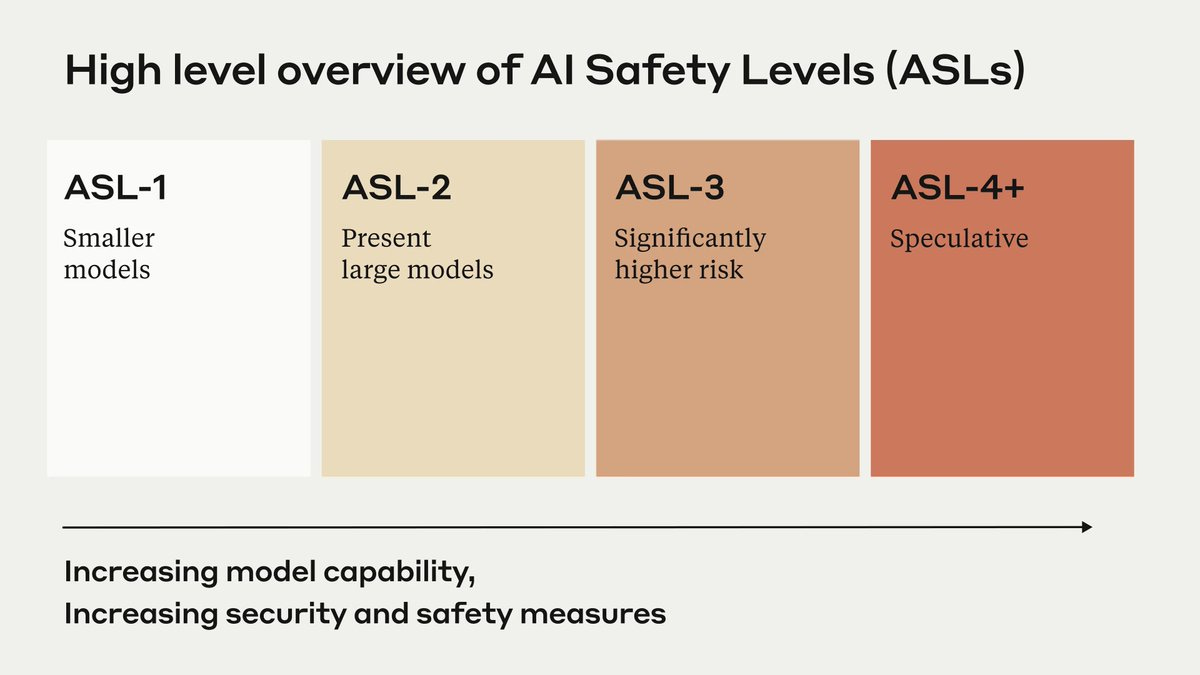

Han creado un sistema para rastrear el ⚠️ peligro:

«Niveles ASL» (AI Safety Levels) del 1 al 5

Modelos actuales: ASL-2

Próximo año: ASL-3

2026: probablemente ASL-4

Pero ASL-3 es el verdadero punto de inflexión:

En ASL-3:

Los modelos pueden mejorar las capacidades de los malos actores para infringir daños masivos

Se necesitan nuevos protocolos de seguridad

Se necesitan filtros mejorados

Restricciones de despliegue

«Si llegamos al ASL-3 el año que viene, no estaremos preparados».

Pero eso no es lo que más asusta:

Su gran avance fue darse cuenta:

No programamos la IA, la hacemos crecer (@ch402).

Como los sistemas complejos evolucionan gracias a la biología:

Creamos las bases

Creamos la luz

Pero el sistema crece por sí mismo.

Esto nos llevó a un descubrimiento impactante:

Mirando en el interior de las redes neuronales, descubrieron algo salvaje:

Todas las IA desarrollan características universales, como los cerebros biológicos.

Los mismos patrones aparecen en

Modelos de visión de IA

Cerebros de mono

Redes neuronales humanas

La naturaleza sigue reinventando las mismas soluciones.

Aún más extraño:

Cada gran modelo lingüístico desarrolla una «neurona Donald Trump».

Es la única personalidad que siempre tiene su propia neurona.

¿Por qué? No se sabe.

Pero revela algo crucial sobre el desarrollo de la IA:

El problema de datos que todo el mundo teme:

«Nos quedaremos sin datos de Internet»

¿La solución de Anthropic?

Modelos que se enseñan a sí mismos mediante el autoaprendizaje. 🤖 📣 🤖

Esto cambia todo los tiempos previstos en el calendario:

Sus modelos han pasado de:

Nivel de secundaria (2022)

Nivel universitario (2023)

Nivel de doctorado (2024)

En algunas tareas, superan a los expertos humanos.

El verdadero avance podemos verlos en algunos campos tan importantes como la programación

Las IA de programación han pasado de resolver:

3% de las tareas reales (enero)

50% de las tareas reales (octubre)

A este ritmo, alcanzará el nivel humano el año que viene.

Pero lo que más preocupa no es cuando lleguen al nivel del humano, si no cuando empiecen a aumentar su rendimiento al 200%, 500%…

Estas IAs no sólo se están volviendo más inteligentes.

Y no solo eso, están desarrollando (@AmandaAskell):

Intereses profundos

Perspectivas únicas

Personalidades complejas

Comprensión abstracta

Lo que nos lleva a la cuestión más importante:

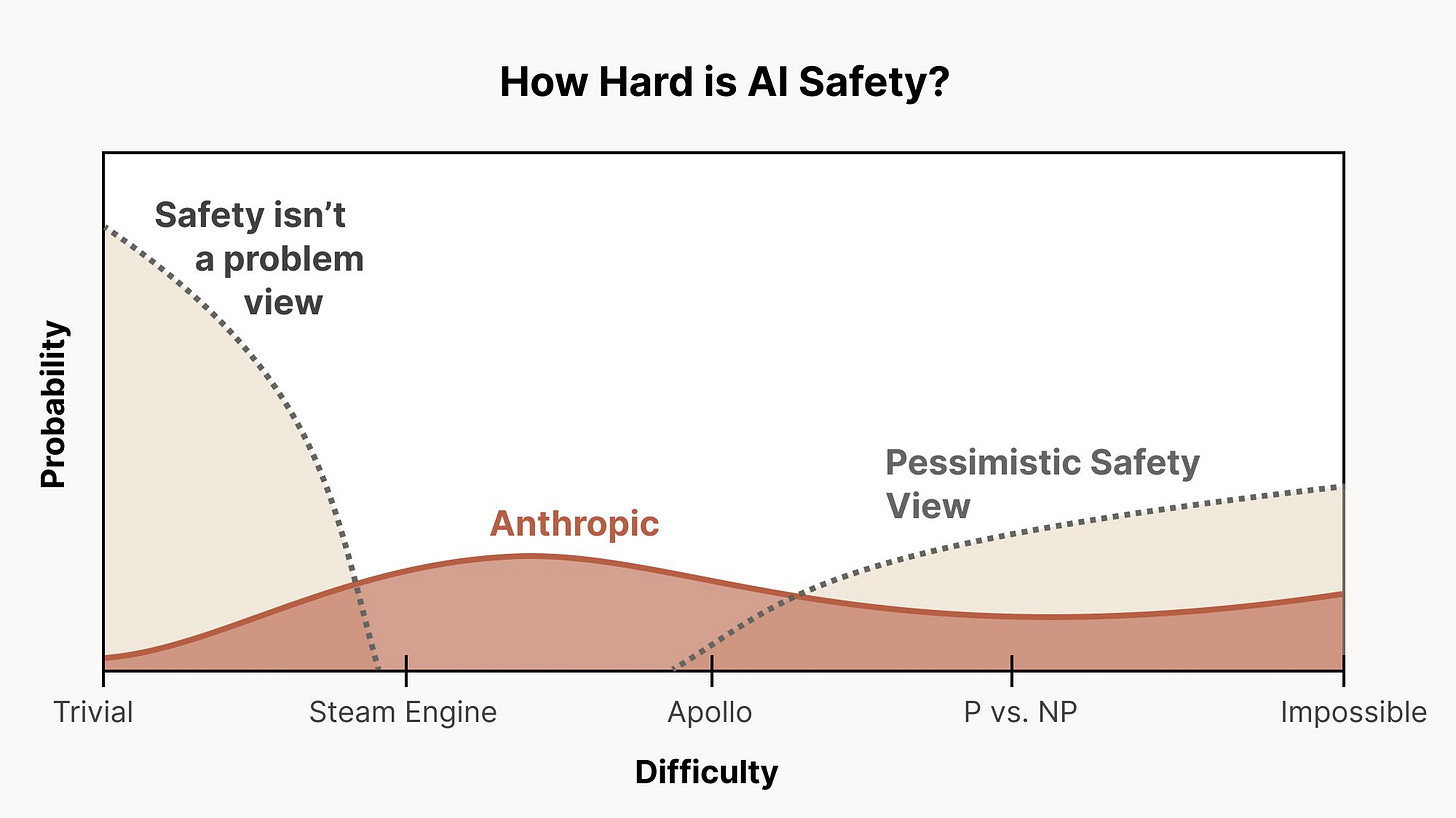

El verdadero plazo no es tecnológico.

ES REGLAMENTARIO:

«Si llegamos a finales de 2025 sin una regulación significativa de la IA, me voy a preocupar».

El tiempo apremia.

Lex Fridman y Darío profundizaron mucho más en temas relacionados con la IA y, especialmente, con la inteligencia artificial.

Si te interesa, te recomiendo que veas el episodio completo aquí:

Pero, ¿qué hacemos hasta que la Super-Inteligencia llegue?

Los laboratorios de inteligencia artificial (IA) más avanzados, como OpenAI y Anthropic, están convencidos de que estamos en camino hacia modelos más grandes y potentes, capaces de superar la inteligencia humana en áreas especializadas. Sin embargo, aunque estos sistemas aún están lejos, los modelos actuales, como GPT-4, ya están transformando la forma en que trabajamos y vivimos.

Lo que ya puede hacer la IA

Las herramientas de IA actuales son multimodales: generan texto, imágenes, sonido y video; escriben código; operan computadoras; y navegan por internet. Aunque no son perfectas, son útiles en muchos campos donde:

No se espera precisión absoluta.

Es valiosa una segunda opinión.

No hay otras soluciones humanas disponibles.

Un ejemplo es el análisis de videos en tiempo real. Un modelo como Claude 3.5 puede revisar un video de un sitio de construcción, detectar problemas de seguridad, sugerir mejoras y crear listas de acciones priorizadas.

Aunque sus observaciones no son perfectas, en entornos donde la supervisión es limitada, la IA puede actuar como una herramienta de apoyo invaluable.

IA en el trabajo digital

En el entorno digital, los sistemas de IA ya realizan tareas que antes eran exclusivas de los humanos:

Navegan sitios web y completan formularios.

Realizan análisis y pruebas.

Elaboran informes cualitativos y narrativos.

Por ejemplo, se puede pedir a una IA que pruebe plataformas de comercio electrónico como Walmart o Amazon, y genere informes detallados. Aunque no son los análisis más profundos, estas tareas se ejecutan de manera eficiente y rápida, liberando tiempo para que los humanos se enfoquen en actividades más estratégicas.

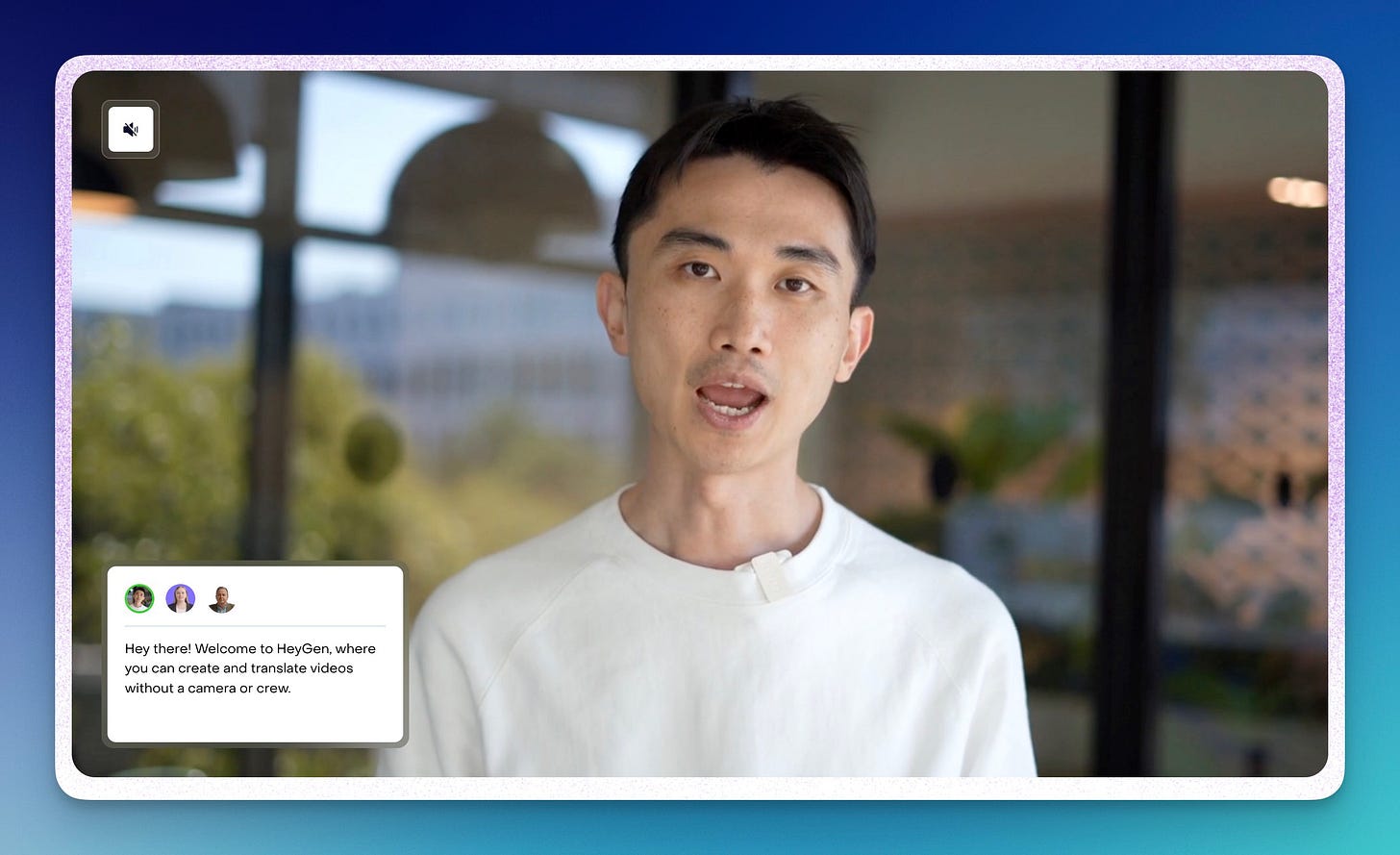

El lado inquietante: Avatares virtuales y vigilancia

Las capacidades de la IA van más allá de lo funcional. Los avatares generados por IA pueden participar en videollamadas simulando reuniones corporativas. Aunque aún enfrentan problemas como voces artificiales o fallos visuales, estas herramientas ya están lo suficientemente avanzadas como para engañar a algunas personas.

Sin embargo, el uso de estas tecnologías plantea preguntas éticas:

¿Serán herramientas para apoyar y mentorizar, o se convertirán en mecanismos de control y vigilancia?

¿Potenciarán nuestras capacidades, o sustituirán el juicio humano?

El futuro está en nuestras manos

Incluso sin alcanzar la superinteligencia, la IA actual ya tiene un impacto profundo en el trabajo y la sociedad. Las decisiones que tomemos hoy sobre su uso definirán si estas herramientas se utilizan para elevar el potencial humano o para limitarlo.

Es crucial implementar políticas y prácticas responsables que prioricen a las personas sobre los algoritmos. La integración de la IA no es solo un desafío técnico, sino una oportunidad para rediseñar la relación entre humanos y tecnología, asegurando que esta transformación potencie nuestra creatividad y capacidades en lugar de reemplazarlas.

¿Te ha gustado esta edición de AI Mafia Club?

✅ Compártelo con uno o dos amigos. ¡Ayuda a tus compañeros a crecer!

❌ Si odiaste este newsletter - compártelo con un enemigo 😂

Además ganarás recompensas por los amigos que traigas a la mafia!

Nota: va a haber una recompensa muy importante en las próximas semanas. Luego que no se diga que no AVISÉ! ;)

❤️ Gracias por leer AI Mafia.

Si te ha gustado esta edición, no te olvides de dar al ♡ y de compartirla por redes sociales o por email con otras personas a las que creas que les pueda gustar. Si lo haces, etiquétanos en @aimafiaclub, nos encantaría saber de ti. 🙏

También nos gustaría escuchar tus opiniones y sugerencias, así que no dudes en responder a este correo. O dejar un comentario abajo.

Si quieres mantenerte al día con las últimas novedades IA:

📺 Youtube: IA para emprendedores en Youtube

📢 Comunidad en Telegram: https://t.me/AImafiaClub. (Ya somos +1k 💪🏾)

🐦 X: @aimafiaclub

PD: Este correo electrónico fue escrito totalmente por un humano. En concreto por mi ☝️ @alex_dc 😉

Nos vemos la próxima semana…